Pensez-vous que le design des réseaux sociaux a un impact sur votre temps passé sur ces plateformes sociales, sur vos choix ?

Dans notre précédent article, nous avons vu la notion de biais cognitif et comment ils participent au taux de conversion sur un site e-commerce. A présent, nous allons voir comment les réseaux sociaux nous influencent à travers les biais cognitifs et les Dark Pattern dans le cadre de leur business model. Ainsi, nous comprendrons mieux comment les plateformes sociales maintiennent notre attention en moyenne 2h27 par jour !

Mais quel lien entre entre Design de l’attention, Dark Pattern et Biais Cognitifs ? Découvrez-le tout de suite !

Qu’est-ce que les Dark Pattern, le design de l’attention ?

Le design de l’attention (1) est un design qui influence le comportement de l’utilisateur de manière inconsciente pour persuader l’internaute qu’il doit atteindre l’objectif voulu (par l’entreprise qui le met en place). En clair, c’est une méthode qui influence notre choix via le design. Elle englobe les Dark Pattern et les biais cognitifs.

Plus précisément, un Dark Pattern est une interface utilisateur créée dans le but de manipuler, voire de tromper, son utilisateur grâce à des choix graphiques et des éléments mis en place pour attirer le plus longtemps possible/guider l’internaute.

Où pouvons-nous les rencontrer sur les réseaux sociaux ?

- Les Dark Pattern dans les paramètres de confidentialité de Facebook

Nous pouvons retrouver particulièrement des Dark Pattern sur Facebook et notamment dans les paramètres de confidentialité, appelés « Privacy Zuckering ». Ils portent le nom du PDG de Facebook du fait de son utilisation. Cette méthode consiste à amener les utilisateurs à rendre publiques beaucoup plus d’informations que ce qu’ils souhaiteraient réellement partager.

L’utilisation de Dark Pattern appelée « modèles sombres » se basent sur les biais cognitifs afin de nous inciter à prendre des décisions irrationnelles. En utilisant cette méthodes dites « trompeuses », les réseaux sociaux augmenteront le temps de l’internaute sur la plateforme et les guideront vers l’objectif attendu (bénéfique pour accroître leur chiffre d’affaires).

Nous pouvons observer par exemple :

– Des icônes exposées de manière fortement visibles et positives (engageantes) pour encourager le chemin de l’internaute dans la direction souhaitée par Facebook.

– Des données qui sont définies par défaut « paramètre par défaut ». Pour les modifier, l’utilisateur se lance sur un parcours complexe du fait de son nombre élevé de cases à cocher ou à décocher. (2)

D’après l’auteur Colin Gray, professeur de relations internationales et d’études stratégiques à l’université de Reading « les valeurs par défaut sont définies avec une confidentialité moindre à l’esprit : “Si vous avez une centaine de cases à cocher, qui va le faire ?” » (3)

– Facebook nous met en garde lors de la désactivation de ses fonctionnalités de reconnaissance faciale en faisant appel à nos émotions : « Si vous maintenez la reconnaissance faciale désactivée, nous ne pourrons pas utiliser cette technologie si un étranger utilise votre photo pour se faire passer pour vous ». Le bouton pour activer le réglage est lumineux et bleu tandis que le bouton pour le garder éteint est gris (moins accrocheur). (10)

- Les Dark Pattern pour manipuler nos choix de parcours sur Facebook

Les réseaux sociaux proposent un menu bien défini sur leurs interfaces. « Ils donnent l’illusion d’un libre choix aux internautes, tout en architecturant le menu afin qu’ils puissent gagner à tous les coups, et ce, peu importe ce que vous choisissez. Vous n’imaginez pas à quel point cette idée est fondamentale pour les concepteurs de ces plateformes », d’après Tristan Harris. Le fait de mettre en place ce menu défini, donne aux réseaux sociaux un pouvoir, celui de décider de notre parcours et de notre consommation sur leurs plateformes. C’est une manière de détourner la façon dont les internautes perçoivent leur choix et les remplace par des nouveaux.

Lors de la fermeture d’un compte, la construction de l’information et le design nous rendent la tâche difficile pour nous dissuader de clôturer notre compte, que ce soit sur le plan technique, ou émotionnel. La plateforme culpabilise l’utilisateur qui souhaite la quitter avec des messages de type : « Si vous partez, vous ne recevrez plus aucune nouvelle de X… ». (2) Nous pouvons voir également le message : « Êtes-vous sûr de vouloir supprimer votre compte Facebook ? Vous allez manquer à vos amis ». Selon l’informaticien et professeur d’éthique digitale Tristan Harris, « Nous pouvons même voir apparaître les visages de cinq de nos amis jugés les plus proches afin de nous faire annuler la suppression de notre compte. »

Autres exemples :

-« pour vérifier l’heure et le lieu de l’événement que nous souhaitons voir, nous sommes obligés de passer par le Newsfeed. Nous appelons cela « stratégies de persuasion ». Les ingénieurs de la Sillicon Valley l’apprennent à l’école ! » d’après Tristan Harris. (4)

-Nous devons aller sur le fil d’actualité pour accéder à nos messages privés et autres fonctionnalités. Ce qui nous oblige inconsciemment à regarder notre feed, à scroller et à nous laisser embarquer.

-En 2016, Facebook a utilisé les Dark Patterns. pour influencer un maximum d’internautes à accepter l’intégration des SMS en omettant de demander si, « oui » ou « non », nous souhaitons activer cette fonctionnalité. Cela s’est présenté à travers un pop-up qui portait à confusion donnant l’impression que nous n’avions pas d’autres choix que d’appuyer sur le bouton OK. (5)

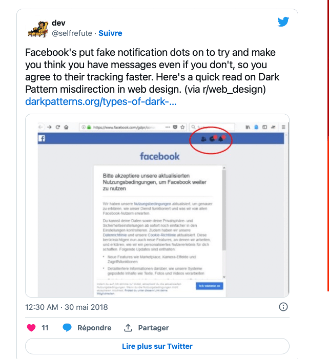

-Un dernier exemple de Dark Patterns sur Facebook : le réseau social met de fausses notifications afin de nous inciter à accepter les paramètres de confidentialité plus vite. (9)

De plus, il est compliqué d’enlever cette notification, nous sommes obligés de lire le message pour faire disparaître cette alerte. D’autant plus, que la couleur rouge a été choisie car c’est une couleur puissante qui incite les internautes à cliquer comme vu dans le précédent article.

- Les Dark Patterns pour manipuler nos choix de parcours sur Instagram

Sur Instagram (Groupe META), nous retrouvons également des Dark Pattern. La plateforme sociale est très proche de cette pratique. En novembre 2020, le journal Le Monde a publié la dernière mise à jour de Instagram, symptôme de « la montée en puissance des Dark Pattern. Le journal reprend les travaux d’Harry Brignull, docteur en sciences cognitives, qui affirme que la façon dont les interfaces sont conçues influence les comportements de leurs utilisateurs. (6) Notamment à travers deux nouvelles fonctionnalités. Pendant la mise à jour, les onglets « notifications » et les « nouvelles publications », situés en bas de l’écran initialement, ont été déplacés en haut de l’écran et remplacés par un onglet « shopping » (pour favoriser les achats) et « Reels » : un nouveau format qui fait fureur depuis la montée en puissance de Tik Tok. Le but est d’influencer l’internaute à cliquer sur ces fonctionnalités en priorité. (7)

De plus, tout comme sur Facebook, les « modèles sombres » sont présents lorsque nous essayons de quitter Instagram. Nous ne pouvons pas supprimer notre compte depuis l’application il faut impérativement se connecter via l’interface web du réseau social (8) . Même si nous désactivons notre compte depuis l’interface web, le parcours est compliqué pour arriver au but souhaité. Des questions nous sont mêmes posées : Pourquoi désactivez-vous ? Trop distrayant ? Ici, essayez de désactiver les notifications. Juste besoin d’une pause ? Pensez à vous déconnecter, d’après Christophe Moyen, Catherine Vidal dans Promethosia. (3)

Le design de l’attention sert les objectifs marketing des réseaux sociaux dans le cadre de leur business model. Grâce à cette méthode, le temps d’utilisation des internautes est élevé, et de nombreuses informations sont récoltées. Des informations essentielles pour continuer à garder attentifs les internautes et accroître leur chiffre d’affaires.

D’après vous, est-ce de la manipulation malsaine, ou une manipulation légitime dans le cadre d’un business model ?

Merci de votre lecture !

- 3 Christophe Moyen, Catherine Vidal. PROMETHOSIA. NUDGE ET INTELLIGENCE ARTIFICIELLE, COUP DOUBLE OU COUP FOURRÉ ? (11/20)